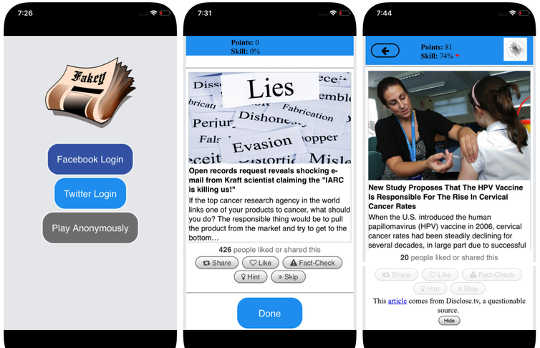

Tangkapan layar dari game Palsu. Mihai Avram dan Filippo Menczer

Tangkapan layar dari game Palsu. Mihai Avram dan Filippo Menczer

Media sosial adalah salah satunya sumber berita utama di AS dan di seluruh dunia. Namun para pengguna terpapar pada isi dari akurasi yang dipertanyakan, termasuk teori konspirasi, Clickbait, konten hyperpartisan, ilmu semu dan bahkan membuat laporan "berita palsu".

Tidak mengherankan bahwa begitu banyak desinformasi yang diterbitkan: Spam dan penipuan online menguntungkan bagi penjahat, dan hasil propaganda pemerintah dan politik baik manfaat partisan maupun finansial. Namun fakta itu konten kredibilitas rendah menyebar dengan sangat cepat dan mudah menunjukkan bahwa orang-orang dan algoritma di balik platform media sosial rentan terhadap manipulasi.

Penelitian kami telah mengidentifikasi tiga jenis bias yang membuat ekosistem media sosial rentan terhadap kesalahan informasi yang disengaja dan disengaja. Itu sebabnya kami Observatorium di Media Sosial di Indiana University sedang membangun alat untuk membantu orang menjadi sadar akan bias ini dan melindungi diri mereka dari pengaruh luar yang dirancang untuk mengeksploitasinya.

Menjelaskan alat yang dikembangkan di Observatorium di Media Sosial:

{youtube}https://youtu.be/BIv9054dBBI{/youtube}

Bias di otak

Bias kognitif berasal dari cara otak memproses informasi yang ditemui setiap orang setiap hari. Otak hanya dapat menangani sejumlah informasi yang terbatas, dan terlalu banyak rangsangan yang datang dapat menyebabkan informasi yang berlebihan. Itu sendiri memiliki implikasi serius bagi kualitas informasi di media sosial. Kami telah menemukan bahwa persaingan yang tajam untuk perhatian terbatas pengguna berarti itu beberapa ide menjadi viral meskipun kualitasnya rendah - bahkan ketika orang lebih suka berbagi konten berkualitas tinggi.

Untuk menghindari kewalahan, otak menggunakan jumlah trik. Metode-metode ini biasanya efektif, tetapi mungkin juga menjadi bias ketika diterapkan dalam konteks yang salah.

Satu pintasan kognitif terjadi ketika seseorang memutuskan apakah akan berbagi cerita yang muncul di feed media sosial mereka. Orang-orang sangat dipengaruhi oleh konotasi emosional dari judul, meskipun itu bukan indikator yang baik dari akurasi artikel. Yang jauh lebih penting adalah yang menulisnya.

Untuk mengatasi bias ini, dan membantu orang lebih memperhatikan sumber klaim sebelum membagikannya, kami mengembangkannya Palsu, game literasi berita seluler (gratis di Android dan iOS) Simulasi umpan berita media sosial yang khas, dengan campuran artikel berita dari sumber utama dan kredibilitas rendah. Pemain mendapat lebih banyak poin untuk berbagi berita dari sumber terpercaya dan menandai konten yang mencurigakan untuk pemeriksaan fakta. Dalam prosesnya, mereka belajar mengenali sinyal dari kredibilitas sumber, seperti klaim hiperpartisan dan berita utama yang diisi secara emosional.

Bias dalam masyarakat

Sumber bias lain berasal dari masyarakat. Ketika orang terhubung langsung dengan teman sebaya mereka, bias sosial yang memandu pemilihan teman mereka memengaruhi informasi yang mereka lihat.

Bahkan, dalam penelitian kami, kami telah menemukan bahwa itu mungkin untuk menentukan kecenderungan politik dari pengguna Twitter hanya dengan melihat preferensi partisan teman-teman mereka. Analisis kami tentang struktur ini jaringan komunikasi partisan menemukan jejaring sosial sangat efisien dalam menyebarkan informasi - akurat atau tidak - kapan mereka terikat erat dan terputus dari bagian lain dari masyarakat.

Kecenderungan untuk mengevaluasi informasi lebih baik jika berasal dari dalam lingkaran sosial mereka sendiri menciptakan “ruang gema”Yang matang untuk manipulasi, baik secara sadar atau tidak sengaja. Ini membantu menjelaskan mengapa begitu banyak percakapan daring berpindah ke dalamnya Konfrontasi "kami lawan mereka".

Untuk mempelajari bagaimana struktur jejaring sosial online membuat pengguna rentan terhadap disinformasi, kami membangunnya Hoaxy, sistem yang melacak dan memvisualisasikan penyebaran konten dari sumber kredibilitas rendah, dan bagaimana ia bersaing dengan konten yang memeriksa fakta. Analisis kami terhadap data yang dikumpulkan oleh Hoaxy selama pemilihan presiden AS 2016 menunjukkan bahwa akun Twitter yang berbagi informasi yang salah adalah hampir sepenuhnya terputus dari koreksi yang dilakukan oleh pemeriksa fakta.

Ketika kami mengebor akun penyebar informasi yang salah, kami menemukan kelompok inti akun yang sangat padat saling retweet hampir secara eksklusif - termasuk beberapa bot. Satu-satunya saat organisasi pemeriksa fakta pernah dikutip atau disebutkan oleh pengguna dalam kelompok yang salah informasi adalah ketika mempertanyakan legitimasi mereka atau mengklaim kebalikan dari apa yang mereka tulis.

Bias dalam mesin

Kelompok ketiga bias muncul langsung dari algoritma yang digunakan untuk menentukan apa yang dilihat orang secara online. Kedua platform media sosial dan mesin pencari mempekerjakan mereka. Teknologi personalisasi ini dirancang untuk hanya memilih konten yang paling menarik dan relevan untuk setiap pengguna individual. Tetapi dengan demikian, mungkin akhirnya memperkuat bias kognitif dan sosial pengguna, sehingga membuat mereka lebih rentan terhadap manipulasi.

Misalnya, detailnya alat iklan yang dibangun di banyak platform media sosial biarkan pelaku kampanye disinformasi untuk mengeksploitasi bias konfirmasi by pesan menjahit kepada orang-orang yang sudah cenderung mempercayai mereka.

Juga, jika pengguna sering mengeklik tautan Facebook dari sumber berita tertentu, Facebook akan cenderung menunjukkan orang itu lebih banyak dari konten situs itu. Ini disebut "bubble filter”Efek dapat mengisolasi orang dari beragam perspektif, memperkuat bias konfirmasi.

Penelitian kami sendiri menunjukkan bahwa platform media sosial memaparkan pengguna ke kumpulan sumber yang kurang beragam daripada situs media non-sosial seperti Wikipedia. Karena ini pada tingkat platform keseluruhan, bukan dari satu pengguna, kami menyebutnya ini bias homogenitas.

Unsur penting lainnya dari media sosial adalah informasi yang sedang tren di platform, sesuai dengan apa yang mendapatkan klik paling banyak. Kami menyebutnya bias popularitas, karena kami telah menemukan bahwa algoritme yang dirancang untuk mempromosikan konten populer dapat berdampak negatif terhadap kualitas keseluruhan informasi di platform. Ini juga menjadi bias kognitif yang ada, memperkuat apa yang tampak populer terlepas dari kualitasnya.

Semua bias algoritmik ini dapat dimanipulasi oleh bot sosial, program komputer yang berinteraksi dengan manusia melalui akun media sosial. Sebagian besar bot sosial, seperti Twitter Big Ben, tidak berbahaya. Namun, beberapa menyembunyikan sifat asli mereka dan digunakan untuk maksud jahat, seperti meningkatkan disinformasi atau salah menciptakan penampilan gerakan akar rumput, juga disebut "astroturfing." Kami menemukan bukti manipulasi jenis ini menjelang pemilihan paruh waktu 2010 AS.

Untuk mempelajari strategi manipulasi ini, kami mengembangkan alat untuk mendeteksi bot sosial yang disebut Botometer. Botometer menggunakan pembelajaran mesin untuk mendeteksi akun bot, dengan memeriksa ribuan fitur akun Twitter yang berbeda, seperti waktu postingnya, seberapa sering tweets, dan akun yang diikuti dan retweet. Itu tidak sempurna, tetapi telah mengungkapkan bahwa sebanyak 15 persen akun Twitter menunjukkan tanda-tanda menjadi bots.

Menggunakan Botometer bersama dengan Hoaxy, kami menganalisis inti dari jaringan misinformasi selama kampanye presiden AS 2016. Kami menemukan banyak bot yang mengeksploitasi bias kognitif, konfirmasi, dan popularitas korban-korban mereka dan bias algoritmik Twitter.

Bot ini dapat membangun gelembung filter di sekitar pengguna yang rentan, memberi mereka klaim palsu dan misinformasi. Pertama, mereka dapat menarik perhatian pengguna manusia yang mendukung calon tertentu dengan menge-tweet hashtag kandidat atau dengan menyebutkan dan me-retweet orang tersebut. Kemudian bot dapat memperkuat klaim palsu yang mengotori lawan dengan me-retweet artikel dari sumber kredibilitas rendah yang cocok dengan kata kunci tertentu. Kegiatan ini juga membuat sorotan algoritma untuk pengguna lain cerita palsu yang dibagikan secara luas.

Memahami kerentanan yang kompleks

Bahkan ketika penelitian kami, dan yang lain, menunjukkan bagaimana individu, institusi dan bahkan seluruh masyarakat dapat dimanipulasi di media sosial, ada banyak pertanyaan kiri untuk menjawab. Sangat penting untuk mengetahui bagaimana perbedaan bias berinteraksi satu sama lain, berpotensi menciptakan kerentanan yang lebih kompleks.

Alat seperti kami menawarkan pengguna internet informasi lebih lanjut tentang disinformasi, dan karena itu beberapa tingkat perlindungan dari kerugiannya. Solusinya akan tidak mungkin hanya teknologi, meskipun mungkin akan ada beberapa aspek teknis bagi mereka. Tetapi mereka harus memperhitungkan aspek kognitif dan sosial masalah.

Tentang Penulis

Giovanni Luca Ciampaglia, Asisten Peneliti Sains, Institut Sains Jaringan Universitas Indiana, Indiana University dan Filippo Menczer, Profesor Ilmu Komputer dan Informatika; Direktur Pusat untuk Jaringan Kompleks dan Riset Sistem, Indiana University

Artikel ini awalnya diterbitkan pada Percakapan. Membaca Artikel asli.

Buku terkait

at

Terimakasih telah berkunjung InnerSelf.com, dimana ada 20,000 + artikel yang mengubah hidup yang mempromosikan "Sikap Baru dan Kemungkinan Baru". Semua artikel diterjemahkan ke dalam 30+ bahasa. Berlangganan ke Majalah InnerSelf, diterbitkan mingguan, dan Inspirasi Harian Marie T Russell. Innerself Majalah telah diterbitkan sejak tahun 1985.

Terimakasih telah berkunjung InnerSelf.com, dimana ada 20,000 + artikel yang mengubah hidup yang mempromosikan "Sikap Baru dan Kemungkinan Baru". Semua artikel diterjemahkan ke dalam 30+ bahasa. Berlangganan ke Majalah InnerSelf, diterbitkan mingguan, dan Inspirasi Harian Marie T Russell. Innerself Majalah telah diterbitkan sejak tahun 1985.